클라우드 환경에서 AI 모델을 효율적으로 배포하고 스케일링하는 실전 전략: AWS, GCP, Azure 비교 분석

주요 클라우드 플랫폼별 AI 배포 환경 비교 분석

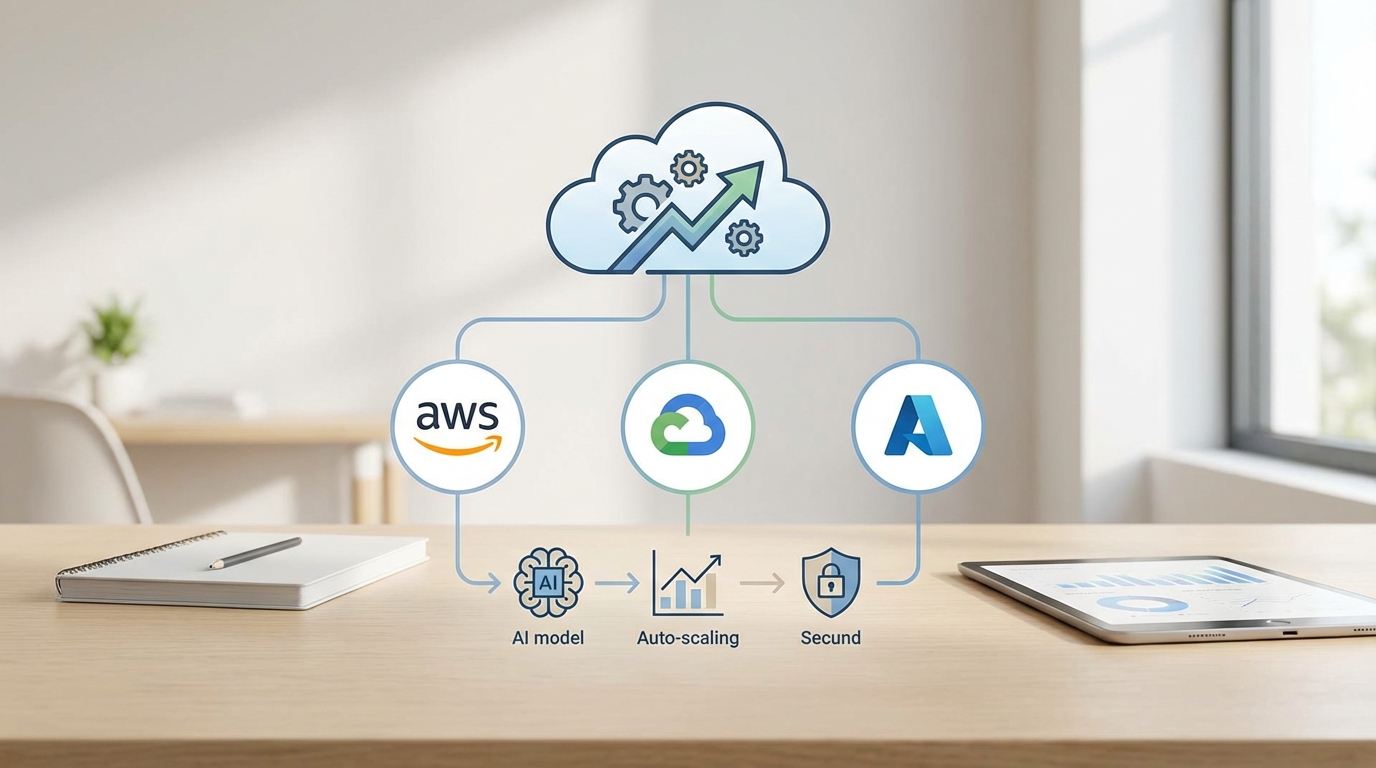

AI 모델을 개발하여 실제 서비스로 배포할 때, 가장 먼저 고민하게 되는 것은 클라우드 벤더의 선택입니다. AWS, GCP, Azure는 각기 다른 강점을 가지고 있으며, 프로젝트의 성격에 따라 적절한 선택이 필요합니다. AWS의 SageMaker는 가장 방대한 생태계를 자랑하며, 특히 최근에는 'Aurora DB'와 같은 AWS 네이티브 데이터베이스 기능을 십분 활용하여 AI 모델의 메타데이터 관리나 추론 결과의 고속 저장을 구현하는 것이 트렌드입니다. 이는 데이터 정합성과 확장성을 동시에 잡는 전략입니다.

반면 GCP의 Vertex AI는 구글의 TPU 인프라를 활용한 고성능 학습 및 추론에 강점이 있으며, Azure Machine Learning은 엔터프라이즈 환경에서의 통합과 OpenAI 서비스와의 연동성이 뛰어납니다. 단순히 모델을 올리는 것을 넘어, 주변 인프라(DB, 스토리지)와의 연계성을 고려하여 플랫폼을 선정해야 합니다.

프로덕션 안정성을 위한 LTS(Long Term Support) 버전 활용 전략

개발 환경에서는 최신 기능을 사용하기 위해 'Nightly' 빌드나 최신 버전을 사용하는 경우가 많지만, 실제 사용자가 접속하는 프로덕션 환경에서는 이야기가 다릅니다. 최근 개발 커뮤니티(devkobe24 등)의 동향을 보면 LTS(Long Term Support) 버전의 중요성이 다시금 강조되고 있습니다. LTS 버전을 사용해야 하는 이유는 명확합니다.

첫째, 3년 이상의 장기 보안 업데이트가 제공되어 AI 모델 서빙 컨테이너의 취약점을 지속적으로 관리할 수 있습니다. 둘째, 프레임워크 및 라이브러리 차원에서 우선적인 지원을 받을 수 있어 예기치 않은 버그에 빠르게 대응할 수 있습니다. 셋째, 커뮤니티 레퍼런스가 풍부하여 스케일링 시 발생하는 문제 해결이 수월합니다. 따라서 Docker 베이스 이미지나 딥러닝 프레임워크 선정 시 반드시 LTS 지원 여부를 확인하는 것이 안정적인 스케일링의 첫걸음입니다.

AI 에이전트 시대의 보안: 멀티 에이전트 통신과 MITM 위협

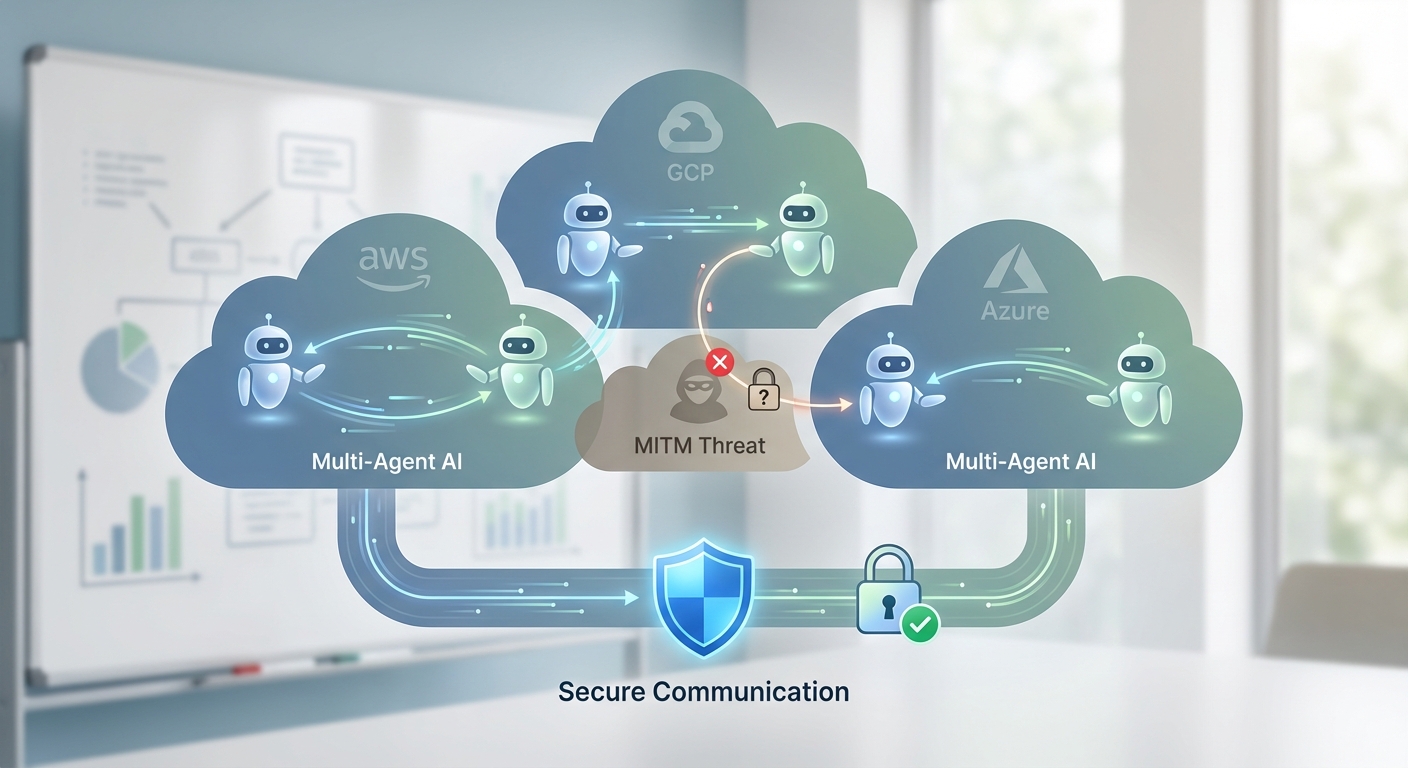

최근 AI 시스템은 단일 모델을 넘어, 여러 AI가 협업하는 '멀티 에이전트(Multi-Agent)' 구조로 진화하고 있습니다. 클라우드에서 이러한 에이전트들을 배포하고 스케일링할 때 간과하기 쉬운 것이 바로 보안입니다. 최신 보안 분석에 따르면, AI 에이전트 간의 통신 과정에서 발생하는 MITM(Man-in-the-Middle, 중간자 공격) 위협이 증가하고 있습니다.

에이전트들이 서로 데이터를 주고받으며 작업을 수행할 때, 이 통신 채널이 암호화되지 않거나 인증 체계가 허술하면 민감한 추론 데이터가 탈취되거나 조작될 수 있습니다. 따라서 오토스케일링 그룹 내의 인스턴스 간 통신에도 mTLS(상호 TLS)를 적용하고, VPC 엔드포인트를 활용하여 외부 인터넷 노출을 최소화하는 아키텍처를 설계해야 합니다. 이는 성능 최적화만큼이나 중요한 배포 전략의 핵심입니다.

개발자 김지섭의 실전 배포 노하우

AI 기술은 하루가 다르게 변하지만, '안정성'과 '효율성'이라는 본질은 변하지 않습니다. 저 김지섭은 다양한 프로젝트를 경험하며, 단순히 최신 기술을 도입하는 것보다 현재 인프라 상황에 맞는 최적의 도구를 선택하는 것이 중요하다는 것을 체감했습니다. 오토스케일링 정책을 설정할 때는 CPU 사용량뿐만 아니라, 추론 대기열(Queue)의 깊이나 지연 시간(Latency)을 복합적인 지표로 활용해야 불필요한 비용 지출을 막을 수 있습니다.

오늘 공유해 드린 클라우드별 특징과 LTS 활용, 그리고 보안 전략이 여러분의 AI 서비스를 한 단계 더 견고하게 만드는 데 도움이 되기를 바랍니다. 기술적인 구현 난이도와 운영 편의성 사이에서 균형을 잡는 것이 성공적인 AI 배포의 열쇠입니다.