AI 모델의 예측 오류를 찾아라: 개발자를 위한 필수 테스트 및 디버깅 가이드

1. 기본 중의 기본: 데이터 파이프라인을 위한 단위 및 통합 테스트

AI 개발에서 모델 아키텍처만큼 중요한 것이 바로 데이터가 흐르는 파이프라인의 무결성입니다. 많은 개발자가 모델의 정확도(Accuracy)에만 집중하지만, 실제 서비스 장애는 데이터 전처리 과정이나 입출력 형식의 불일치에서 발생하는 경우가 많습니다.

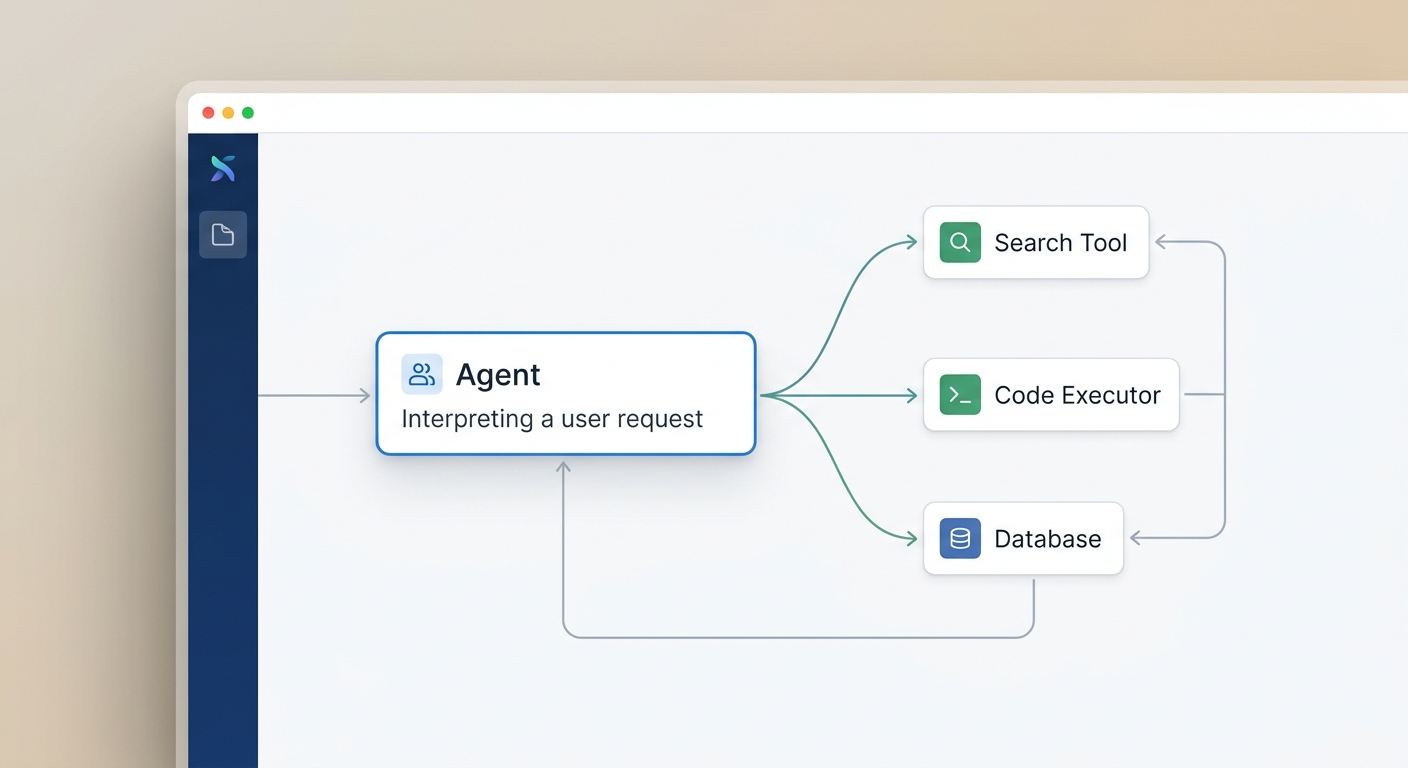

이를 예방하기 위해 단위 테스트(Unit Testing)는 필수적입니다. 예를 들어, 이미지를 전처리하는 함수가 픽셀 값을 0과 1 사이로 정확히 정규화하는지, 텍스트 토크나이저가 특수 문자를 의도대로 처리하는지 검증해야 합니다. 또한, 통합 테스트(Integration Testing)를 통해 데이터 수집부터 모델 추론, 그리고 결과 반환까지의 전체 과정이 끊김 없이 연결되는지 확인해야 합니다. 이는 마치 자동차의 엔진 성능뿐만 아니라, 엔진과 바퀴가 제대로 연결되어 굴러가는지를 확인하는 과정과 같습니다.

2. AI의 허점을 찌르는 적대적 테스트 (Adversarial Testing)

일반적인 소프트웨어와 달리 AI 모델은 확률에 기반하여 작동하기 때문에, 기존의 테스트 방식만으로는 예측 불가능한 오류를 잡아내기 어렵습니다. 이때 필요한 것이 바로 적대적 테스트(Adversarial Testing)입니다. 이는 모델이 가장 헷갈려 할 만한 데이터를 고의로 주입하여 오작동을 유도하는 기법입니다.

예를 들어, 자율주행 AI에게 '눈이 덮인 표지판'이나 '역광이 비치는 신호등' 같은 노이즈가 섞인 이미지를 입력해보는 것입니다. 사람의 눈에는 큰 차이가 없어 보이지만, AI 모델에게는 치명적인 오류를 일으킬 수 있는 미세한 변조(Perturbation)를 가해봄으로써 모델의 견고성(Robustness)을 점검할 수 있습니다. 개발자는 이러한 '엣지 케이스(Edge Case)'를 지속적으로 발굴하여 학습 데이터에 포함시킴으로써 모델의 방어력을 높여야 합니다.

3. 김지섭의 제언: 지속 가능한 AI 디버깅 시스템 구축

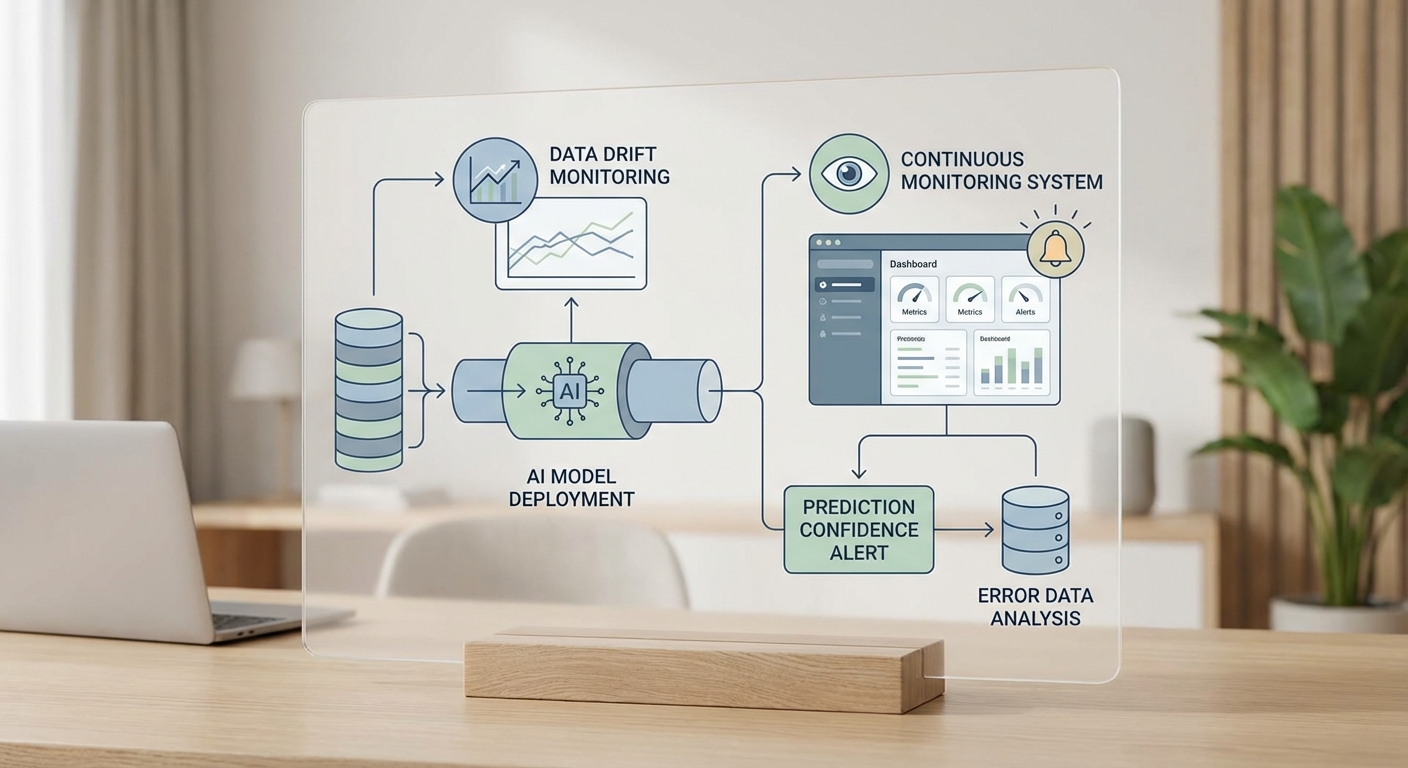

AI 모델은 배포가 끝이 아니라 시작입니다. 시간이 지남에 따라 입력 데이터의 분포가 변하는 '데이터 드리프트(Data Drift)' 현상이 발생하면, 어제까지 잘 작동하던 모델도 오늘 오류를 낼 수 있습니다. 따라서 효과적인 디버깅을 위해서는 단순한 코드 수정을 넘어 지속적인 모니터링 시스템이 뒷받침되어야 합니다.

개발자로서 저는 프로젝트를 진행할 때, 모델의 예측 신뢰도가 특정 임계값 이하로 떨어질 경우 즉시 알림을 받고 해당 데이터를 별도로 저장하여 분석하는 루틴을 만드는 것을 권장합니다. AI 기술에 대한 전문성을 바탕으로 이러한 체계적인 검증 프로세스를 구축해 두는 것이야말로, 사용자에게 신뢰받는 서비스를 제공하는 가장 확실한 방법입니다.