OpenVINO를 활용한 AI 모델 최적화: 온디바이스 AI 성능 극대화 개발 기법

클라우드 의존도를 낮추고 기기 자체에서 AI를 구동하는 온디바이스 AI 시대, 성능 극대화의 핵심인 OpenVINO 활용법을 알아봅니다. 모델 경량화부터 NPU 가속화까지 실질적인 개발 팁을 제공합니다.

온디바이스 AI와 성능 최적화의 중요성

최근 AI 기술은 클라우드 서버에서 벗어나 사용자 기기 내부에서 직접 구동되는 온디바이스(On-Device) AI로 진화하고 있습니다. 이는 개인 정보 보호, 낮은 지연 시간, 오프라인 작동 등 강력한 이점을 제공하지만, 제한된 하드웨어 리소스라는 큰 기술적 과제를 안고 있습니다. 모바일, 엣지 기기의 CPU, GPU, 그리고 최근 부상하는 NPU(신경망 처리 장치) 성능을 최대한 활용하지 못하면 사용자 경험은 저하될 수밖에 없습니다.

특히 얼굴 인식이나 산업 현장의 실시간 지능화와 자율화를 위한 모델의 경우 빠른 추론 속도가 필수적입니다. 이 AI 모델의 목표는 동일 인물의 얼굴 특징값을 공간상에서 최대한 가깝게 군집화하고, 다른 인물의 얼굴은 명확히 분리해 정확도를 극대화하는 동시에, 이를 실시간으로 처리할 수 있는 성능 확보가 매우 중요합니다. 이를 위해 모델의 크기를 줄이고 특정 하드웨어에 최적화하는 과정이 반드시 필요합니다.

OpenVINO 툴킷: 아키텍처 및 핵심 워크플로우

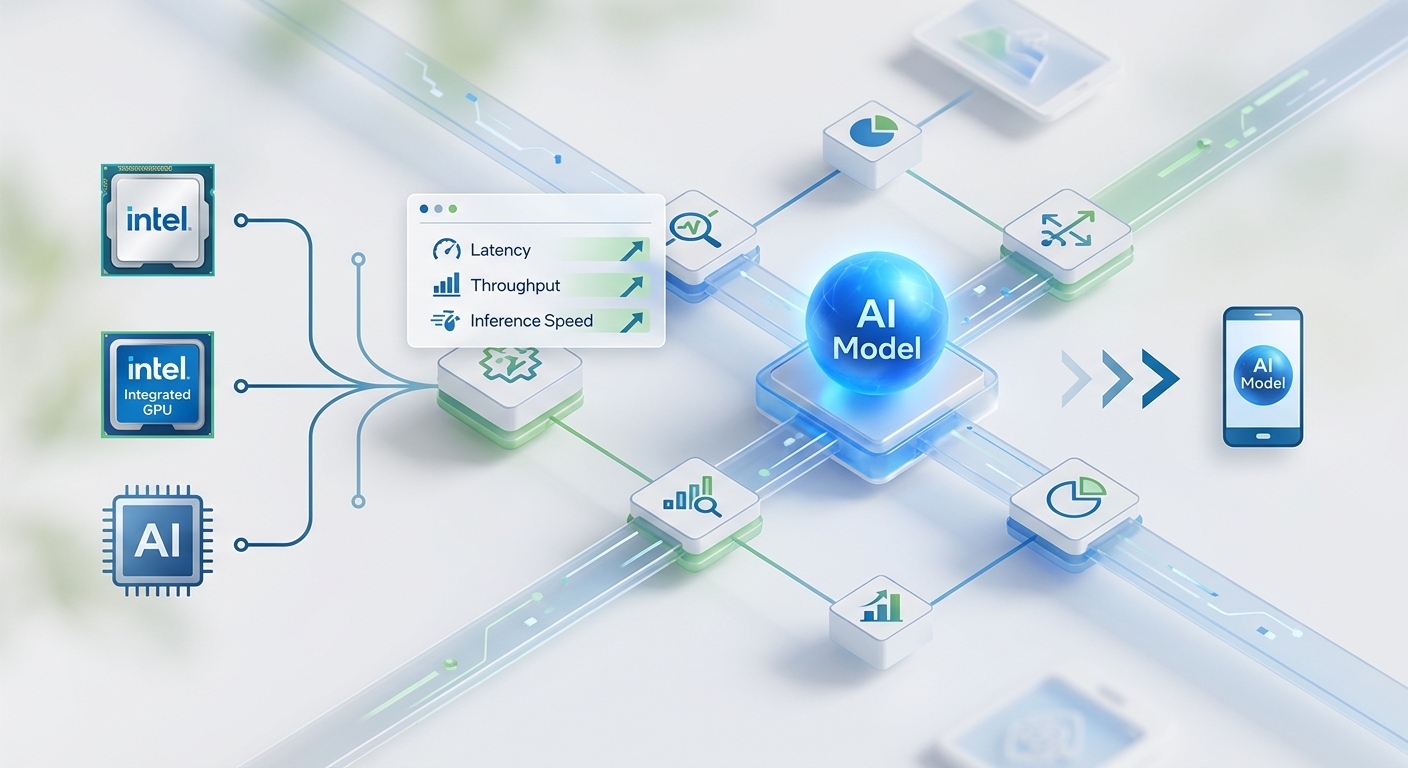

Intel의 OpenVINO(Open Visual Inference and Neural Network Optimization)는 이러한 성능 극대화 요구를 충족시키는 대표적인 오픈소스 툴킷입니다. TensorFlow, PyTorch 등 다양한 프레임워크에서 학습된 모델을 가져와 특정 인텔 하드웨어(CPU, 내장 GPU, NPU)에서 최상의 성능을 발휘하도록 최적화하고 배포할 수 있게 도와줍니다.

OpenVINO의 핵심 워크플로우는大きく 두 단계로 나뉩니다. 첫 번째는 모델 옵티마이저(Model Optimizer)를 통해 학습된 모델을 중간 표현(IR: Intermediate Representation) 형식인 .xml 및 .bin 파일로 변환하는 것입니다. 이 과정에서 불필요한 레이어가 제거되고 통합되는 등 정적 최적화가 이루어집니다. 두 번째는 인퍼런스 엔진(Inference Engine)을 사용하여 이 IR 모델을 타겟 하드웨어 로드하고 실제 추론을 수행하는 단계입니다. 개발자는 애플리케이션 코드를 거의 변경하지 않고 타겟 디바이스(플러그인 아키텍처)를 동적으로 변경하여 가속 효과를 얻을 수 있습니다.

개발자가 적용할 수 있는 실무 최적화 실천 팁

OpenVINO의 잠재력을 온전히 끌어내기 위해 개발자가 실무에 적용할 수 있는 구체적인 팁들은 다음과 같습니다. 첫째, 데이터 타입 최적화(양자화)를 적극 활용해야 합니다. FP32(32비트 부동소수점) 모델을 FP16 또는 INT8로 변환하면 정확도 손실을 최소화하면서 모델 크기를 대폭 줄이고 하드웨어 가속 성능을 크게 향상시킬 수 있습니다. 특히 NPU에서는 INT8 양자화가 필수적인 경우가 많습니다.

둘째, NPU와 같은 전용 가속기를 우선적으로 활용하도록 구성해야 합니다. OpenVINO의 인퍼런스 엔진 설정 시 'DEVICE' 파라미터를 'NPU'로 설정하여 CPU 부하를 낮추고 전력 효율을 높이면서 추론 속도를 극대화할 수 있습니다. 셋째, 모델 최적화 도구(NNCF 등)를 활용하여 학습 과정에서부터 최적화를 고려하는 'Post-Training Quantization' 혹은 'Quantization-Aware Training' 기법을 도입하는 것도 고려해 볼 만합니다. 이러한 기법들은 정확도를 최대한 유지하면서 양자화 효과를 얻는 데 매우 효과적입니다.

성능 극대화를 위한 하드웨어 활용 및 트레이드오프 고려

마지막으로 하드웨어 리소스의 특성을 깊이 이해하고 트레이드오프를 고려한 설계가 필요합니다. 모든 모델이 NPU에서 최고의 성능을 내는 것은 아닙니다. 모델의 레이어 구성에 따라 CPU나 GPU에서 더 유리할 수도 있습니다. OpenVINO가 제공하는 성능 분석 도구(Benchmark Tool)를 활용하여 각 하드웨어에서의 추론 속도와 처리량을 꼼꼼히 측정하고, 이를 바탕으로 최적의 하드웨어 조합을 선택해야 합니다.

또한 산업 현장의 지능형 보안 시스템처럼 정확도와 실시간성 모두 중요한 경우, 무조건적인 경량화보다는 목표 정확도를 충족하는 범위 내에서의 최적화 수준을 결정하는 것이 중요합니다. 때로는 정확도를 아주 조금 희생하더라도 지연 시간을 획기적으로 줄여 시스템 전체의 효용성을 높이는 것이 온디바이스 AI 개발자의 핵심 역량이라고 할 수 있습니다.

마무리 및 AI 개발자 김지섭의 제언

온디바이스 AI 환경에서 OpenVINO는 제한된 리소스를 극복하고 고성능 AI 서비스를 구현하기 위한 강력한 무기입니다. 단순히 기술을 적용하는 것을 넘어 모델의 특성과 타겟 하드웨어의 아키텍처를 이해하고, 다양한 최적화 기법을 실험하며 최적의 균형점을 찾아가는 과정이 필수적입니다. 이러한 과정은 곧 지능화와 자율화를 선도하는 기술력의 원천이 됩니다.

지금까지 살펴본 OpenVINO 활용법이 온디바이스 AI 성능 극대화를 고민하는 개발자분들에게 실질적인 도움이 되었기를 바랍니다. AI 개발자로서 끊임없이 변화하는 기술 트렌드와 새로운 최적화 기법들에 관심을 가지고 함께 성장해 나갈 수 있기를 기대합니다.